Danke für Ihr Interesse an den Lernpräferenzen!

Danke für dein Interesse an verschiedenen Lernmethoden! Welche Methode bevorzugst du? (z. B. „Audio“, „Video“, „Text“, „Keine Präferenz“) (optional)

Feedback sendenAlgorithmusoptimierung Definition

Die Optimierung von Algorithmen ist ein entscheidender Aspekt in der Informatik, besonders in der Softwareentwicklung. Wenn du lernst, wie du Algorithmen effizienter gestalten kannst, schaffst du eine Grundlage für schnellere und ressourcenschonendere Softwarelösungen. Eine fundierte Kenntnis der Algorithmusoptimierung ermöglicht es dir, komplexe Probleme effektiver zu lösen.

Was ist Algorithmusoptimierung?

Unter Algorithmusoptimierung versteht man die Verbesserung eines Algorithmus hinsichtlich seiner Laufzeit und/oder seines Speicherbedarfs. Ziel ist es, einen Algorithmus so umzustrukturieren, dass er effizienter arbeitet, was oft zu auffällig besseren Leistungsergebnissen führt.Hier sind einige häufige Ansätze zur Optimierung von Algorithmen:

- Komplexitätsreduktion: Analyse und Reduzierung der zeitlichen und räumlichen Komplexität

- Dynamische Programmierung: Verwendung von gespeicherten Ergebnissen zur Vermeidung von Wiederholungen

- Heuristiken: Einsatz von Regeln, die auf Erfahrung beruhen, um schnellere Lösungen zu finden

Grundlagen der Algorithmusoptimierung

Die Welt der Algorithmusoptimierung ist eine faszinierende und dynamische Sphäre innerhalb der Informatik. Wenn du die Grundlagen verstehst, kannst du Programme entwickeln, die nicht nur korrekt funktionieren, sondern dies auch auf effizienteste Weise tun.

Die Bedeutung der Optimierung

In der Praxis geht es bei der Optimierung darum, die Ressourcen zu maximieren, während die Berechnungen minimiert werden. Effiziente Algorithmen sparen sowohl Zeit als auch Energie und können große Datenmengen schneller verarbeiten. In vielen Anwendungen, wie Echtzeitsystemen, ist die Optimierung kein Luxus, sondern eine Notwendigkeit.

Ein Algorithmus ist eine Schrittfolge, die ein Problem löst. Die Optimierung eines Algorithmus bezieht sich darauf, diese Schritte effizienter zu gestalten, um die Leistung zu maximieren.

Beispiel: Stell dir vor, du hast eine Liste mit Zahlen und möchtest die größte Zahl herausfinden. Ein einfacher Algorithmus wäre, alle Zahlen durchzugehen und die größte zu speichern. Bei einer optimierten Methode könntest du jedoch Techniken verwenden, um die Anzahl der Vergleiche zu reduzieren.

Techniken der Algorithmusoptimierung

Es gibt zahlreiche Techniken zur Optimierung von Algorithmen, die sich in verschiedene Kategorien einteilen lassen. Hier sind einige der gängigsten:

- Iterative Verbesserung: Verwende Schleifen oder rekursive Methoden sparsam, um die Effizienz zu steigern.

- Dynamische Programmierung: Speichere Zwischenlösungen, um Berechnungen zu vermeiden, die mehrfach ausgeführt werden könnten.

- Greedy-Algorithmen: Triff lokal optimale Entscheidungen in der Hoffnung, eine global optimale Lösung zu erhalten.

In der Berechnungsgeometrie werden oft sehr komplexe Probleme behandelt, wie z.B. die Bestimmung der konvexen Hülle. Hierbei kommen optimierte Algorithmen wie der Graham-Scan zum Einsatz, der mit einer Komplexität von

Erinnere dich daran: Eine gute Optimierung beginnt oft mit einer genauen Analyse der bestehenden Herausforderungen.

Techniken der Algorithmusoptimierung

Algorithmusoptimierung spielt eine wichtige Rolle bei der Verbesserung der Effizienz und Leistung von Computeralgorithmen. Optimierte Algorithmen reduzieren sowohl die Laufzeit als auch den Speicherbedarf, was in vielen praktischen Anwendungen entscheidend ist.

Unterschiedliche Ansätze

Wenn du Algorithmen optimieren willst, stehen dir verschiedene Ansätze zur Verfügung. Im Folgenden findest du einige gängige Methoden:

- Divide and Conquer: Diese Technik teilt ein großes Problem in kleinere Teilprobleme, die dann einzeln gelöst und kombiniert werden. Ein bekanntes Beispiel ist der Merge-Sort-Algorithmus, der eine Komplexität von

- Greedy-Methoden: Bei diesem Ansatz wird lokal die beste Entscheidung getroffen, in der Hoffnung, eine globale Lösung zu finden. Dies ist oft in Netzwerkrouting oder bei der Suche nach minimalen Spannbäumen anwendbar.

- Memorization: Ergebniszwischenspeicherung, um doppelte Berechnungen zu vermeiden. Diese Technik wird häufig in der dynamischen Programmierung eingesetzt, wie z.B. beim Berechnen der Fibonacci-Zahlen.

Beispiel für Divide and Conquer:Der Schnell-Sortierungsalgorithmus ist ein hervorragendes Beispiel für diese Technik. Hier wird eine Liste in kleinere Listen aufgeteilt, die dann rekursiv sortiert werden. Der Ansatz lautet:

function quickSort(arr) { if (arr.length <= 1) return arr; let pivot = arr[0]; let left = [], right = []; for (let i = 1; i < arr.length; i++) { if (arr[i] < pivot) left.push(arr[i]); else right.push(arr[i]); } return quickSort(left).concat(pivot, quickSort(right));} Die Wahl der richtigen Optimierungsstrategie hängt stark von der Art des Problems und den gegebenen Daten ab.

Effiziente Strategien

In der Algorithmusoptimierung sind effiziente Strategien essenziell, um Rechenzeit und Ressourcen effizient zu verwalten. Eine effektive Strategie kombiniert verschiedene Techniken, um das beste Ergebnis zu erzielen.

Ein tieferer Einblick in die dynamische Programmierung zeigt ihre Stärke, besonders bei Problemen, die überlappende Teilprobleme beinhalten. Überlappende Teilprobleme sind jene, die sich aufeinander beziehen und wiederholt auftauchen. Ein klassisches Beispiel ist das Problem des kürzesten Hamiltonischen Wegs, bei dem Bellman's Principle of Optimality angewendet wird.Im Fall des Rucksackproblems, bei dem das Ziel darin besteht, den maximalen Wert in einem Rucksack mit begrenztem Gewicht zu finden, lässt sich die Komplexität unter Verwendung von dynamischer Programmierung von

Algorithmusoptimierung in der Informatik

In der Informatik ist die Algorithmusoptimierung von großer Bedeutung. Sie zielt darauf ab, Algorithmen effizienter zu gestalten, um sowohl die Laufzeit als auch den Speicherbedarf zu minimieren. Dadurch werden wertvolle Systemressourcen gespart und die Leistung von Software verbessert.

Bedeutung und Anwendungen

Die Optimierung von Algorithmen stellt sicher, dass Programme schneller und kostengünstiger arbeiten. Viele Anwendungen profitieren direkt von optimierten Algorithmen:

- Suchalgorithmen: Verbesserungen in Algorithmen, wie dem Binärbaum, beschleunigen die Datensuche erheblich.

- Sortieralgorithmen: Effizientere Sortiermethoden, wie der Quicksort, sparen viel Zeit im Vergleich zu naiven Ansätzen.

- Graphenalgorithmen: Optimierte Algorithmen für den kürzesten Weg, wie Dijkstra, verbessern die Netzwerknavigation.

Ein Algorithmus ist eine endliche Abfolge von Anweisungen oder Schritten zur Lösung eines Problems. Optimierung eines Algorithmus bedeutet, dessen Effizienz hinsichtlich Laufzeit und Ressourcenverbrauch zu verbessern.

Die Effizienz eines Algorithmus wird oft in der Big-O-Notation ausgedrückt, die das Wachstumsverhalten in Bezug auf die Eingabegröße beschreibt.

Praxisbeispiele

Praktische Anwendungen der Algorithmusoptimierung finden sich in vielfältigen Bereichen. Hier sind einige Beispiele:Optimierte Suchalgorithmen können in Datenbankabfragen die Suchzeit erheblich reduzieren. Bei großen Datenbanken ist dies entscheidend für schnelle Antwortzeiten. Ein optimierter Binärsuchbaum, etwa der AVL-Baum, kann die Leistung um ein Vielfaches steigern.Im Bereich der Bildverarbeitung spielt die Optimierung eine ebenso kritische Rolle. Algorithmen zur Kantenerkennung oder Segmentierung profitieren von Verbesserungen, die die Bildverarbeitung in Echtzeit ermöglichen.Ein weiteres Beispiel sind Komprimierungsalgorithmen wie Huffman-Codierung, die durch effektive Optimierung den erforderlichen Speicherplatz drastisch reduzieren können.

Hier ein einfaches Beispiel zur Veranschaulichung:Stell dir ein Problem vor, bei dem du die Summe aller Zahlen von 1 bis

function naiveSum(n) { let sum = 0; for (let i = 1; i <= n; i++) { sum += i; } return sum;}Diese Lösung hat eine Zeitkomplexität von Ein tiefgehender Einblick in die Komplexitätstheorie zeigt die verschiedenen Klassen von Problemen auf, die auf unterschiedliche Weise optimiert werden können. Einige Probleme sind NP-vollständig, was bedeutet, dass sie keine bekannte Lösung in polynomialer Zeit haben und daher besonders interessant für die Algorithmusoptimierung sind. Ein populäres Beispiel ist das Rucksackproblem, das durch fortgeschrittene Optimierungstechniken, wie z.B. approximative Algorithmen, strategisch angegangen werden kann. Diese Techniken suchen Lösungen, die zwar nicht optimal, aber innerhalb eines akzeptablen Spielraums liegen. Oftmals werden Heuristiken verwendet, um NP-schwere Probleme näherungsweise zu lösen, wodurch kommerzielle Anwendungen wie Logistik und Netzwerkdesign profitieren können.

Übungen zu Algorithmusoptimierung

Die Praxis ist ein wesentlicher Bestandteil beim Erlernen der Algorithmusoptimierung. Übungen helfen dir, das Gelernte anzuwenden und die Performance von Algorithmen zu verbessern, indem Theorie in konkreten Beispielen umgesetzt wird.

Interaktive Aufgaben

Interaktive Aufgaben sind eine hervorragende Möglichkeit, um sich mit der Algorithmusoptimierung vertraut zu machen. Sie bieten ein dynamisches Umfeld, in dem du Analysen durchführen und deine Lösungen unmittelbar testen kannst.Hier sind einige Beispiele für interaktive Aufgaben:

- Simuliere den Bubble-Sort: Implementiere den bekannten Sortieralgorithmus und optimiere ihn, indem du unnötige Vergleiche reduzierst.

- Analyse der Zeitkomplexität: Schreibe einfache Testfälle für verschiedene Algorithmen und vergleiche ihre Laufzeiten.

- Dynamische Programmierung anwenden: Löse das Rucksackproblem, indem du Wiederholungen minimierst und die Performance verbesserst.

Beispiel: Fibonacci-Folge optimierenDie Berechnung der Fibonacci-Folge zeigt wunderbar, wie Optimierungen eingesetzt werden können. Hier ist ein Beispiel:

function fib(n) { if (n <= 1) return n; return fib(n - 1) + fib(n - 2);}Diese Implementierung hat eine exponentielle Zeitkomplexität von function fibOptimized(n) { let fib = [0, 1]; for (let i = 2; i <= n; i++) { fib[i] = fib[i - 1] + fib[i - 2]; } return fib[n];}Diese Version hat eine lineare Zeitkomplexität von Algorithmusoptimierung - Das Wichtigste

- Algorithmusoptimierung zielt darauf ab, Algorithmen effizienter zu gestalten, um Laufzeit und Speicherbedarf zu minimieren.

- Grundlagen der Algorithmusoptimierung bestehen aus Methoden wie Komplexitätsreduktion, dynamische Programmierung und Heuristiken.

- Zu den Techniken der Algorithmusoptimierung gehören iterative Verbesserung, Memorization und Divide and Conquer.

- Algorithmusoptimierung in der Informatik ist essenziell für Ressourcenschonung und Leistungssteigerung, z.B. in Such- und Sortieralgorithmen.

- Beispiele für Algorithmusoptimierung umfassen die Optimierung der Fibonacci-Folge und die Anwendung von dynamischer Programmierung zur Lösung des Rucksackproblems.

- Übungen zu Algorithmusoptimierung beinhalten interaktive Aufgaben wie Bubble-Sort Simulation und Analyse der Zeitkomplexität.

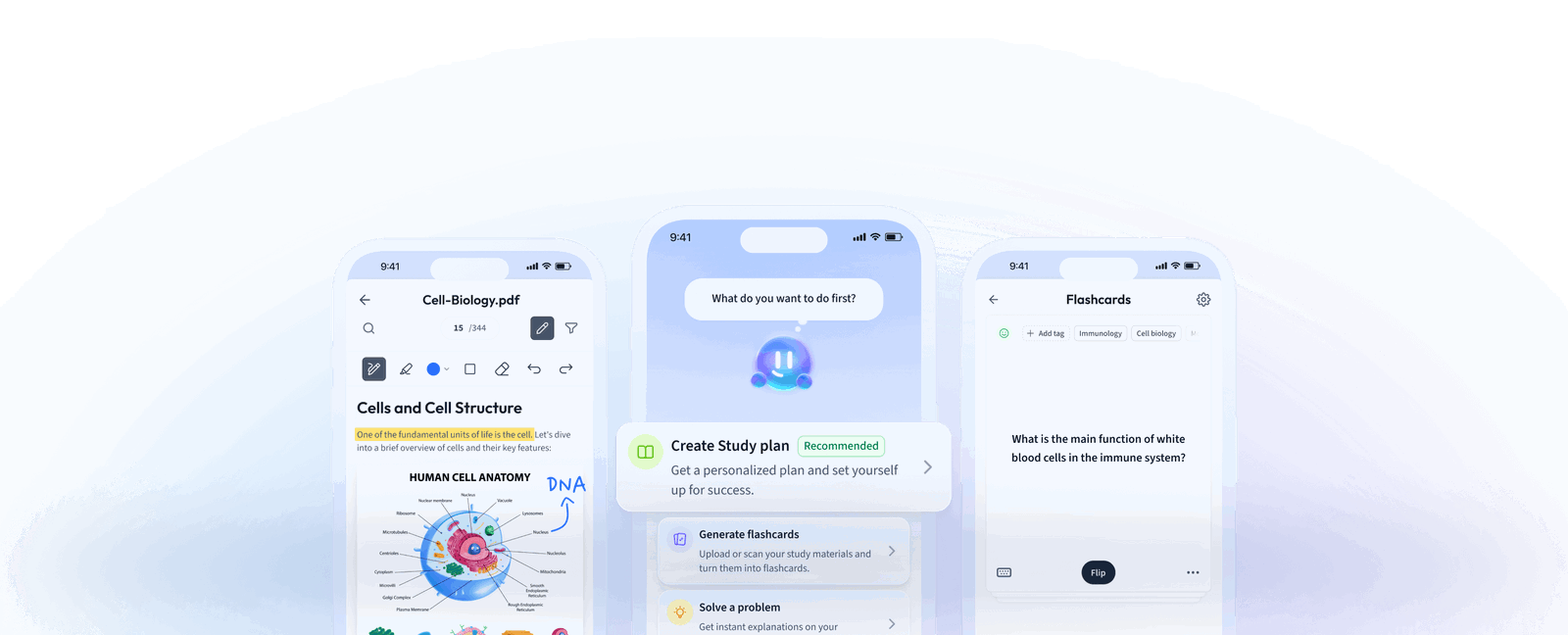

Lerne schneller mit den 10 Karteikarten zu Algorithmusoptimierung

Melde dich kostenlos an, um Zugriff auf all unsere Karteikarten zu erhalten.

Häufig gestellte Fragen zum Thema Algorithmusoptimierung

Über StudySmarter

StudySmarter ist ein weltweit anerkanntes Bildungstechnologie-Unternehmen, das eine ganzheitliche Lernplattform für Schüler und Studenten aller Altersstufen und Bildungsniveaus bietet. Unsere Plattform unterstützt das Lernen in einer breiten Palette von Fächern, einschließlich MINT, Sozialwissenschaften und Sprachen, und hilft den Schülern auch, weltweit verschiedene Tests und Prüfungen wie GCSE, A Level, SAT, ACT, Abitur und mehr erfolgreich zu meistern. Wir bieten eine umfangreiche Bibliothek von Lernmaterialien, einschließlich interaktiver Karteikarten, umfassender Lehrbuchlösungen und detaillierter Erklärungen. Die fortschrittliche Technologie und Werkzeuge, die wir zur Verfügung stellen, helfen Schülern, ihre eigenen Lernmaterialien zu erstellen. Die Inhalte von StudySmarter sind nicht nur von Experten geprüft, sondern werden auch regelmäßig aktualisiert, um Genauigkeit und Relevanz zu gewährleisten.

Erfahre mehr